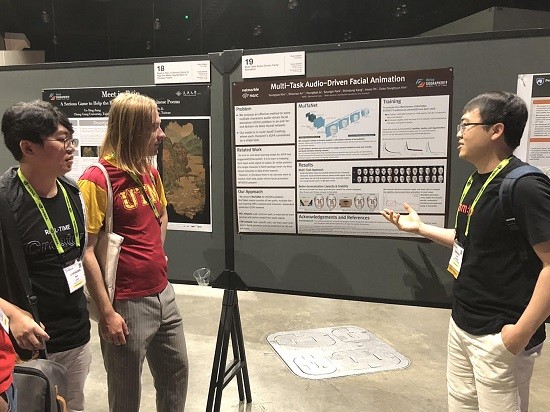

넷마블은 최근 미국 LA에서 열린 세계적인 컴퓨터그래픽 행사인 ‘시그라프(SIGGRAPH) 2019’에서 음성에 맞춰 더욱 자연스러운 얼굴 애니메이션을 자동으로 생성할 수 있는 ‘다중작업방식 음성기반 얼굴 애니메이션(Multi-Task Audio-Driven Facial Animation, MTADFA)’ 기술이 담긴 논문을 발표했다고 6일 밝혔다.

이 행사에서 논문을 발표한 넷마블 AI센터 안수남 팀장은 “넷마블이 업계 최초로 ‘MTADFA’ 기술을 개발했다”며 “인공지능이 자동으로 얼굴 애니메이션을 생성하기 위해 음성과 애니메이션이 짝지어진 예시를 보며 학습하는 과정이 필요하다”고 말했다. 이어 “넷마블의 차세대 기술인 MTADFA는 인공지능이 더욱 다양한 예시를 학습할 수 있도록 해 기존보다 더욱 자연스럽고 안정적인 애니메이션을 생성할 수 있다”며 “새로운 언어음성 입력 시에도 입술 움직임을 동기화하는 능력이 우수해 다국어 지원 게임 개발 시 활용도가 높을 것”이라고 설명했다.

MTADFA는 넷마블이 자체적으로 개발한 딥 뉴럴 네트워크인 멀타넷(MulTaNet: Multi-Task Deep neural Networks)을 활용한다. 실험 데이터에서 제공하는 14명의 서로 다른 캐릭터의 음성-얼굴 애니메이션을 동시에 학습하며, 이를 활용해 더 많은 캐릭터의 얼굴 애니메이션을 확장해 생성할 수 있는 게 가장 큰 특징이다.

각 개별 캐릭터를 따로 학습시켜야만 하는 기존 방식은 인공지능에 충분한 데이터를 제공하지 못해 최종 생성된 애니메이션에서 떨림현상이 발생하거나, 새로운 언어에 대한 동기화가 맞지 않는 등 문제점이 있었다. 넷마블은 이를 해결하고 진화시키는 데 초점을 맞췄다. 넷마블은 향후 자사 게임 등에 우선적으로 이 기술을 적용해나갈 계획이다.

넷마블 AI센터 오인수 실장은 “음성 입력에 맞춰 자연스러운 얼굴 애니메이션을 자동 생성해주는 기술 개발을 통해 이용자에게 더 높은 생동감과 몰입감을 제공하는 모바일게임을 개발할 수 있으리라 기대한다”며 “많은 시간과 노력이 필요한 애니메이션 등 아트 제작 과정도 자동화할 수 있어 개발 효율성이 더욱 향상될 것으로 전망한다”고 말했다.

![[유통통] 중동전쟁·고환율에 깊어가는 시름…면세점업계 돌파구는?](https://www.cnbnews.com/data/cache/public/photos/cdn/20260415/art_1775627800_176x135.jpg)

![[이색사회공헌(73)] “봉사로 단합”…대한항공의 ‘두마리 토끼’ 잡기](https://www.cnbnews.com/data/cache/public/photos/cdn/20260415/art_1775611212_176x135.jpg)